Intel Xeon 6 導入 NVIDIA DGX Rubin NVL8 系統,負責算力調度與資料管理,成為 AI 推論時代關鍵控制核心。

在NVIDIA的GTC 2026大會上,Intel宣布其Xeon 6處理器將正式進駐NVIDIA DGX Rubin NVL8機架系統,擔任關鍵的CPU中控角色。這項合作不僅延續當前Blackwell平台 (如DGX B300)中以Xeon 6776P所建立的架構基礎,更象徵在代理式AI與即時推論需求爆發的時代,x86平台在異質運算架構中的不可取代性。

CPU重回戰略高地:推論時代的「指揮中樞」

隨著AI工作負載從大規模訓練轉向無所不在的即時推論,系統架構的平衡性變得前所未有的重要。Intel企業副總裁暨資料中心策略規劃部總經理Jeff McVeigh在宣布此消息時指出:「在代理式AI與推論系統的驅動下,CPU扮演至關重要的中控角色,負責管理GPU加速系統間的任務協調、記憶體存取、模型安全與吞吐量」。

在DGX Rubin NVL8機架系統中,Xeon 6的核心職責包括:

• 任務調度與工作負載分配:確保GPU資源被最高效率地利用

• 記憶體管理:應對大型模型與日益增長的KV快取需求,Xeon 6支援高達8 TB系統記憶體

• 模型安全防護:透過Intel Trust Domain Extensions (TDX)提供硬體級隔離,保護CPU至GPU之間資料路徑的機密性

• 異構推論協調:新增對NVIDIA Dynamo的支援,實現CPU與GPU間的協同推論

技術規格解密:Xeon 6為何能勝任AI工廠的「總管」?

根據Intel官方技術資料,Xeon 6處理器針對AI推論工作負載進行了多項關鍵優化:

• 記憶體頻寬革命:採用MRDIMM技術,記憶體頻寬比前一代產品提升2.3倍,最高可達8800 MT/s,確保資料能持續高速傳輸至GPU,避免GPU因等待資料而閒置。

• PCIe 5.0通道:業界領先的PCIe 5.0通道數 (雙插槽最高可達192條),支援高頻寬的GPU與其他加速器互連。

• Priority Core Turbo功能:確保關鍵調度任務能以最高優先級運行,維持系統的即時響應能力。

• 端到端機密運算:Intel TDX不僅保護CPU內的資料,更可透過TDX Connect設計將信任邊界延伸至GPU與其他加速器,確保AI模型與資料在整個處理路徑中的安全性。

合作範圍:從DGX NVL8出發,未來可期

Xeon 6處理器此次被用於DGX Rubin NVL8機架系統,而非更大規模的NVL72機架設計。這延續當前Blackwell平台的設計思路,讓Xeon處理器在基礎的8-GPU節點中擔任主機處理器,負責資料前處理、模型載入、KV快取管理與任務協調。

目前推測採用的具體處理器規格為Xeon 6776P,這款晶片採用全P-core (效能核心)配置,具備64核心與128執行緒,基礎時脈為2.30 GHz,專為AI與HPC等高強度運算工作負載設計。

而業界也密切關注未來Xeon處理器是否會進一步整合進NVL72等超大規模機架系統。考慮到NVIDIA與Intel正在共同開發x86伺服器CPU解決方案,Xeon處理器在接下來Rubin世代中扮演角色,或許會是雙方更深層合作的開端。

生態系意義:x86的延續性與企業級穩定性

對於全球各地正在建置AI工廠的企業而言,Xeon處理器的導入具有深層戰略價值:

• 軟體生態系的延續性:絕大多數企業級應用與AI工作負載都是在x86架構上原生開發與佈署。採用Xeon處理器作為中控角色,意味著企業能沿用現有的軟體工具鏈、管理框架與安全政策,無需為特定架構進行大規模重構。

• 經過驗證的可靠性:Xeon處理器在任務關鍵環境中擁有數十年的佈署經驗,其RAS (可靠性、可用性、可服務性)特性對於需要24小時不間斷運作的AI服務來說相當重要。

• 總體持有成本 (TCO)的最佳化:透過將部分代理式工作負載卸載至Xeon處理器,將使NVIDIA得以優化整體系統的每瓦效能與成本結構。

分析觀點

Intel Xeon 6處理器進駐NVIDIA DGX Rubin NVL8機架系統,此舉的產業意義遠超一份單純的零件供應合約。

首先,這是Intel在AI時代的「防守反擊」。儘管GPU主導訓練市場,但在推論與代理式AI領域,CPU的角色正在被重新定義。而Xeon 6處理器憑藉其龐大的安裝基礎、成熟的軟體生態系,以及在記憶體頻寬、I/O與安全性的技術優勢,成功卡位NVIDIA的下一代AI運算平台。這不僅是商業上的勝利,更是對「CPU在AI時代已無關緊要」論調的有力反擊。

其次,這也印證「推論時代」的系統級思維轉向。過去,AI系統的效能往往被簡化為GPU的浮點運算能力。但是隨著代理式AI的複雜工作流程 (多步驟推理、工具調用、長上下文記憶)成為主流,CPU的調度能力、記憶體頻寬與安全隔離功能,將直接影響著整個系統的有效吞吐量與使用者體驗。而Xeon 6處理器在DGX Rubin系統中扮演角色,則是從「配角」升格為「總管」。

再者,x86生態系的護城河效應在此刻顯現。相較於Arm架構需要一定程度的軟體重構,x86架構的「即插即用」特性對於追求佈署速度的企業而言更具吸引力。當企業要將現有的數據中心應用與新一代AI服務無縫整合時,採用與既有基礎設施一致的x86架構平台,能大幅降低維運複雜度與潛在風險。

最後,從更宏觀的視角來看,NVIDIA與Intel深化合作,同時也反映AI基礎設施正在走向「再平衡」。未來的AI工廠不再只是GPU的獨角戲,而是CPU、GPU、DPU、網路與儲存緊密協同的異構系統。

Xeon 6處理器在DGX Rubin系統中的位置,正是這場「再平衡」運動的最佳註腳。隨著AI持續滲透至各行各業,CPU與GPU如何重新定義分工邊界,將是未來幾年資料中心架構最值得觀察的主題之一。

資料來源

- https://mashdigi.com/intel-xeon-6-processors-are-now-integrated-into-nvidias-dgx-rubin-nvl8-rack-system-becoming-the-command-center-for-the-era-of-ai-inference/

您可能也會喜歡

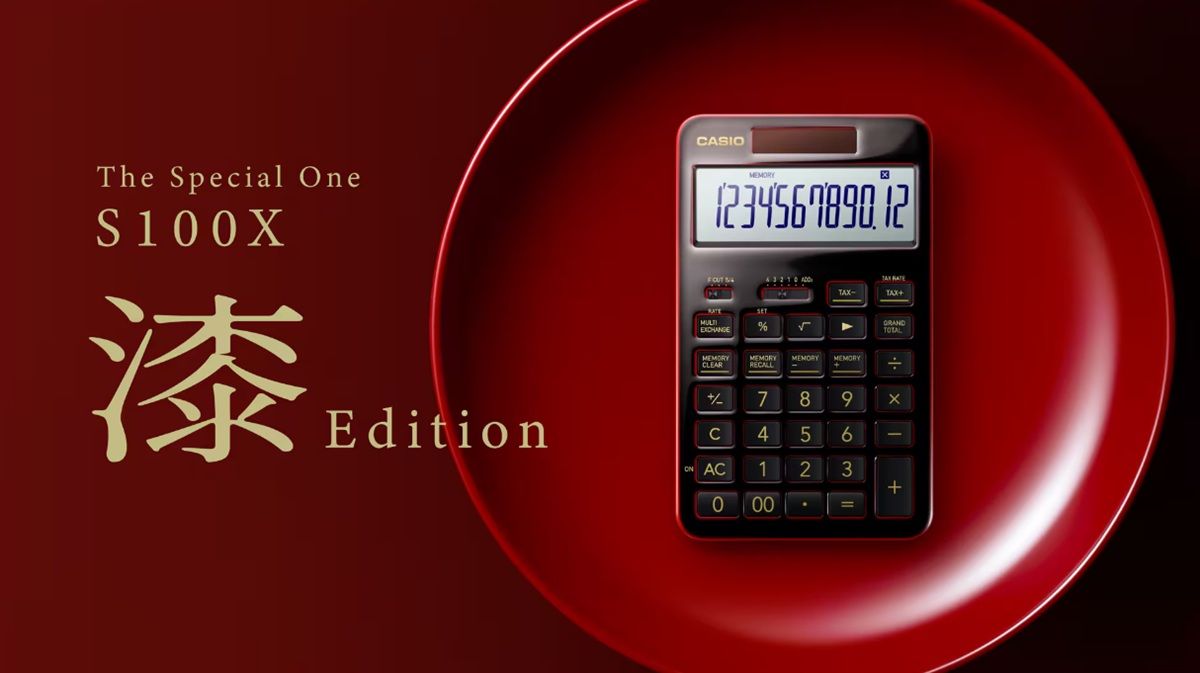

Casio推出越前漆工藝限量計算機S100X-JC1-U,全球限量650台

黃仁勳:AI Token 應該列入工程師薪資結構,已成為矽谷新招聘條件