Acordul OpenAI cu Pentagonul: Sam Altman Obține Contract Crucial de AI cu Măsuri de Siguranță Tehnice

BitcoinWorld

Acordul OpenAI cu Pentagonul: Sam Altman Securizează un Contract AI Crucial cu Măsuri de Protecție Tehnice

Într-o evoluție istorică pentru guvernanța inteligenței artificiale, CEO-ul OpenAI, Sam Altman, a anunțat vineri, 13 octombrie 2025, un contract important de apărare cu Departamentul Apărării, stabilind măsuri de protecție tehnice care abordează preocupări etice critice legate de aplicațiile AI militare. Acest acord urmează unui conflict controversat între Pentagon și compania rivală de AI, Anthropic, evidențiind intersecția complexă dintre securitatea națională, inovația tehnologică și valorile democratice într-o lume din ce în ce mai automatizată.

Acordul OpenAI cu Pentagonul cu Măsuri de Protecție Tehnice

Sam Altman a dezvăluit că OpenAI a ajuns la un acord care permite Departamentului Apărării accesul la modelele sale AI în cadrul rețelelor clasificate. Important, contractul include protecții tehnice specifice care abordează două preocupări etice fundamentale. În primul rând, acordul interzice aplicațiile de supraveghere în masă la nivel intern. În al doilea rând, menține responsabilitatea umană pentru utilizarea forței, inclusiv sistemele de armament autonom. Aceste măsuri de protecție reprezintă o poziție de compromis între accesul militar nerestricționat și refuzul corporativ complet.

Conform declarației publice a lui Altman, Departamentul Apărării este de acord cu aceste principii și le-a încorporat atât în legislație, cât și în politică. În plus, OpenAI va implementa măsuri de protecție tehnice pentru a asigura că comportamentul modelului se aliniază cu aceste restricții. Compania va desfășura, de asemenea, ingineri pentru a lucra alături de personalul Pentagonului, facilitând implementarea corectă a modelului și monitorizarea continuă a siguranței. Această abordare colaborativă distinge strategia OpenAI de pozițiile mai adversariale din industrie.

Confruntarea cu Anthropic și Diviziunile Etice

Acordul OpenAI apare pe fondul negocierilor eșuate între Pentagon și Anthropic. Timp de câteva luni, oficialii apărării au făcut presiuni asupra companiilor AI să permită utilizarea modelelor lor pentru „toate scopurile legale". Cu toate acestea, Anthropic a căutat limitări explicite privind supravegherea în masă la nivel intern și armele complet autonome. CEO-ul Dario Amodei a argumentat că, în cazuri specifice, AI ar putea submina valorile democratice în loc să le apere.

Această poziție etică a atras sprijin semnificativ din partea lucrătorilor din tehnologie. Mai mult de 60 de angajați OpenAI și 300 de angajați Google au semnat o scrisoare deschisă susținând poziția Anthropic. Scrisoarea a solicitat adoptarea la nivel de industrie a unor limite etice similare, reflectând îngrijorarea crescândă în rândul dezvoltatorilor AI cu privire la potențialele aplicații militare ale tehnologiilor lor.

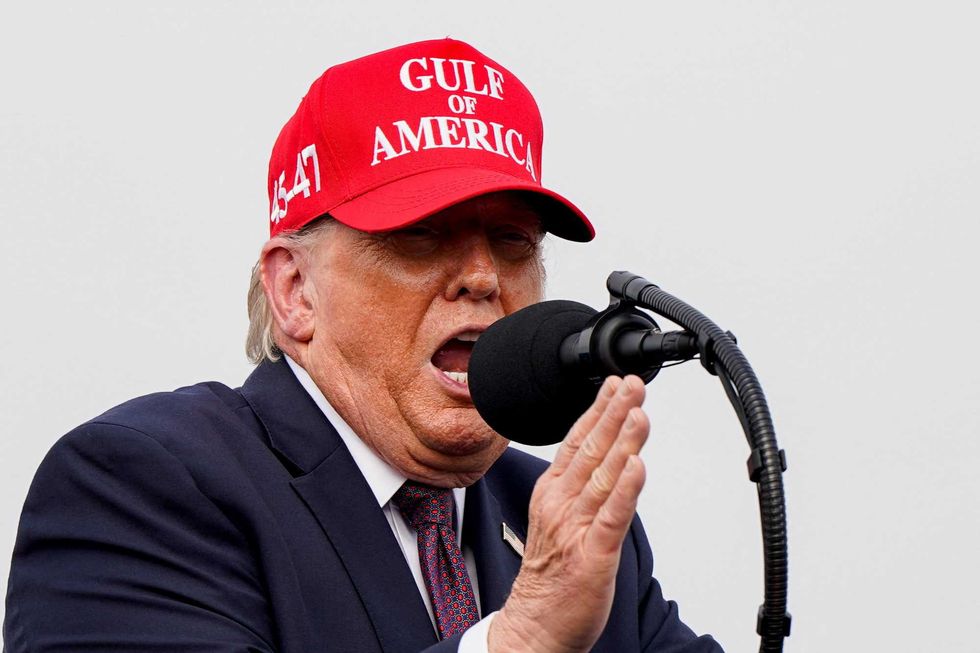

Dezacordul a escaladat într-o confruntare publică cu administrația Trump. Președintele Donald Trump a criticat Anthropic ca fiind „nebuni de stânga" într-o postare pe rețelele sociale. El a indicat agențiilor federale să elimine treptat produsele companiei în termen de șase luni. Secretarul Apărării, Pete Hegseth, a intensificat și mai mult conflictul desemnând Anthropic ca un risc pentru lanțul de aprovizionare. Această desemnare interzice contractorilor și partenerilor care fac afaceri cu armata să se angajeze comercial cu Anthropic.

Implicații pentru Industrie și Peisajul Reglementator

Rezultatele contrastante pentru OpenAI și Anthropic relevă implicații semnificative pentru industria AI. Companiile trebuie acum să navigheze relații complexe cu entitățile guvernamentale, menținând în același timp standarde etice și încrederea publică. Abordarea OpenAI demonstrează că acordurile negociate cu măsuri de protecție specifice reprezintă o cale viabilă înainte. Dimpotrivă, experiența Anthropic arată consecințele potențiale ale adoptării unei poziții etice mai ferme împotriva cerințelor guvernamentale.

Această situație are loc într-un context reglementar mai larg. Multiple națiuni dezvoltă cadre pentru aplicațiile AI militare. Organizația Națiunilor Unite a desfășurat discuții continue despre sistemele de armament autonom letale. În plus, Uniunea Europeană a implementat recent Legea sa privind AI, care include prevederi specifice pentru aplicațiile cu risc ridicat. Aceste evoluții globale creează un mediu din ce în ce mai complex pentru companiile AI care operează în sectoarele de apărare.

Implementare Tehnică și Protocoale de Siguranță

Acordul OpenAI include mai multe componente tehnice concepute pentru a asigura conformitatea cu măsurile de protecție etice. Conform reporterului Fortune, Sharon Goldman, Altman a informat angajații că guvernul va permite OpenAI să construiască propriul „pachet de siguranță" pentru a preveni abuzul. Această infrastructură tehnică reprezintă o componentă critică a acordului. În plus, dacă un model OpenAI refuză să efectueze o sarcină specifică, guvernul nu poate forța compania să modifice comportamentul modelului.

Aceste măsuri tehnice abordează preocupările esențiale privind fiabilitatea și alinierea sistemului AI. Ele oferă mecanisme pentru asigurarea că comportamentul AI rămâne în limitele etice stabilite. Desfășurarea inginerilor OpenAI pentru a lucra direct cu personalul Pentagonului facilitează implementarea corectă și monitorizarea continuă. Această supraveghere tehnică colaborativă reprezintă o abordare inovatoare a parteneriatelor militare-corporative în domeniile tehnologice sensibile.

Comparație a Abordărilor Companiilor AI față de Contractele Militare| Companie | Poziție | Măsuri de Protecție Cheie | Răspunsul Guvernului |

|---|---|---|---|

| OpenAI | Acord negociat | • Fără supraveghere în masă la nivel intern • Responsabilitate umană pentru forță • Măsuri de protecție tehnice • Desfășurare de ingineri | Contract acordat cu măsuri de protecție |

| Anthropic | Limitări etice | • Fără supraveghere în masă • Fără arme autonome • Protecția valorilor democratice | Desemnare ca risc pentru lanțul de aprovizionare Eliminare treptată a produselor ordonată |

Context Mai Larg și Evoluții Internaționale

Acordul OpenAI-Pentagon coincide cu evoluții internaționale semnificative. La scurt timp după anunțul lui Altman, au apărut știri despre acțiunile militare ale SUA și Israelului împotriva Iranului. Președintele Trump a solicitat răsturnarea guvernului iranian. Aceste evoluții simultane evidențiază peisajul geopolitic complex în care sunt implementate tehnologiile AI militare. De asemenea, subliniază actualitatea considerațiilor etice privind sistemele autonome și capacitățile de supraveghere.

La nivel global, națiunile urmăresc abordări variate pentru integrarea AI militară:

- China a urmărit agresiv aplicații AI militare cu mai puține constrângeri etice publice

- Rusia a implementat sisteme autonome în zonele de conflict cu transparență limitată

- Națiunile europene au adoptat în general abordări mai prudente cu supraveghere mai puternică

- Organizația Națiunilor Unite continuă discuțiile cu privire la tratate potențiale privind armele autonome

Acest context internațional creează presiuni competitive care influențează deciziile de politică internă. Statele Unite se confruntă cu provocarea de a menține superioritatea tehnologică în timp ce respectă valorile democratice și standardele etice. Acordul OpenAI reprezintă o abordare de echilibrare a acestor priorități concurente.

Perspectivele Angajaților și Etica Industriei

Scrisoarea deschisă semnată de sute de angajați AI relevă tensiuni interne semnificative în industrie. Lucrătorii din tehnologie pun din ce în ce mai mult sub semnul întrebării implicațiile etice ale muncii lor, în special în ceea ce privește aplicațiile militare. Acest activism al angajaților reprezintă un fenomen relativ nou în sectorul tehnologiei de apărare. Istoric, contractorii de apărare s-au confruntat cu mai puțină rezistență internă la aplicațiile militare. Cu toate acestea, companiile AI atrag angajați cu convingeri etice puternice despre impactul tehnologiei asupra societății.

Această dinamică creează provocări de management pentru companiile AI care urmăresc contracte de apărare. Conducerea trebuie să echilibreze relațiile guvernamentale, oportunitățile de afaceri și preocupările angajaților. Abordarea OpenAI de negociere a măsurilor de protecție specifice reprezintă o strategie pentru abordarea acestor presiuni concurente. Disponibilitatea companiei de a pleda public pentru adoptarea la nivel de industrie a unor termeni similari sugerează o încercare de a stabili norme etice în timp ce menține accesul guvernamental.

Implicații Juridice și de Politici

Desemnarea Anthropic ca risc pentru lanțul de aprovizionare ridică întrebări juridice semnificative. Compania a declarat că va contesta orice astfel de desemnare în instanță. Acest litigiu potențial ar putea stabili precedente importante cu privire la autoritatea guvernamentală de a restricționa relațiile comerciale pe baza pozițiilor etice corporative. Rezultatul poate influența modul în care alte companii AI abordează negocieri similare cu entitățile guvernamentale.

Experții în politici notează mai multe considerații cheie:

- Echilibrul dintre nevoile de securitate națională și autonomia etică corporativă

- Rolul adecvat al măsurilor de protecție tehnice în sistemele AI militare

- Mecanismele pentru asigurarea conformității cu restricțiile etice

- Implicațiile internaționale ale abordărilor naționale diferite

Aceste întrebări de politică vor primi probabil o atenție sporită în lunile următoare. Comitetele congresionale au anunțat deja audiențe privind etica AI militară. În plus, multiple centre de reflecție și instituții de cercetare dezvoltă cadre de politici pentru implementarea responsabilă a AI militară.

Concluzie

Acordul OpenAI cu Pentagonul cu măsuri de protecție tehnice reprezintă o piatră de hotar semnificativă în integrarea AI militară. Acordul demonstrează că abordările negociate cu protecții etice specifice pot facilita accesul guvernamental, abordând în același timp preocupări legitime. Cu toate acestea, experiența contrastantă cu Anthropic relevă tensiuni continue între prioritățile de securitate națională și standardele etice corporative. Pe măsură ce tehnologiile AI continuă să avanseze, aceste relații complexe vor necesita o navigare atentă. Măsurile de protecție tehnice stabilite în acordul OpenAI pot servi drept model pentru viitoarele parteneriate militare-corporative. În cele din urmă, peisajul în evoluție al aplicațiilor AI militare va solicita dialog continuu între entitățile guvernamentale, companiile de tehnologie, angajați și societatea civilă pentru a asigura inovația responsabilă care protejează atât securitatea, cât și valorile democratice.

Întrebări Frecvente

Î1: Ce măsuri de protecție specifice include acordul OpenAI cu Pentagonul?

Acordul interzice aplicațiile de supraveghere în masă la nivel intern și menține responsabilitatea umană pentru utilizarea forței, inclusiv sistemele de armament autonom. OpenAI va implementa măsuri de protecție tehnice și va desfășura ingineri pentru a asigura conformitatea.

Î2: De ce au eșuat negocierile Anthropic cu Pentagonul?

Anthropic a căutat limitări explicite privind supravegherea în masă la nivel intern și armele complet autonome, în timp ce Pentagonul a făcut presiuni pentru accesul pentru „toate scopurile legale". Acest dezacord fundamental a împiedicat un acord negociat.

Î3: Ce consecințe a suferit Anthropic pentru poziția sa etică?

Președintele Trump a ordonat agențiilor federale să elimine treptat produsele Anthropic, iar Secretarul Apărării Hegseth a desemnat compania ca un risc pentru lanțul de aprovizionare, interzicând contractorilor militari să facă afaceri cu aceștia.

Î4: Cum au răspuns angajații din industria AI la aceste evoluții?

Mai mult de 360 de angajați de la OpenAI și Google au semnat o scrisoare deschisă susținând poziția etică a Anthropic, reflectând preocuparea internă semnificativă cu privire la aplicațiile AI militare.

Î5: Ce implicații mai largi are această situație pentru guvernanța AI?

Rezultatele contrastante evidențiază echilibrul complex între securitatea națională, etica corporativă și inovația tehnologică, influențând potențial modul în care alte națiuni și companii abordează integrarea AI militară.

Această postare Acordul OpenAI cu Pentagonul: Sam Altman Securizează un Contract AI Crucial cu Măsuri de Protecție Tehnice a apărut mai întâi pe BitcoinWorld.

Poate îți place și

'Bolnav': MAGA șocați după ce un specialist în sondaje dezvăluie mișcarea administrației Trump înaintea operațiunii militare

Bitcoin a scăzut cu 48%, dar cei mai mari cumpărători din istorie continuă să acumuleze