Akcje Micron (MU); Niewielki spadek pomimo innowacji pamięci 2TB podłączonej do CPU

TLDRs;

- Nowa pamięć 256GB SOCAMM2 firmy Micron skutecznie obsługuje obciążenia AI, podczas gdy akcje pozostają niemal bez zmian.

- Nvidia chwali moduł jako wzmocnienie dla procesorów AI nowej generacji w wysokowydajnych centrach danych.

- SOCAMM2 zmniejsza zużycie energii i zajmowaną przestrzeń w porównaniu z tradycyjnymi modułami serwerów DDR5.

- Przyjęcie przez branżę będzie zależeć od testów klientów, aktualizacji systemów i tempa standaryzacji JEDEC.

Micron Technology (NASDAQ:MU) rozpoczął dystrybucję próbek dla klientów swojego modułu pamięci serwerowej o niskim poborze mocy 256GB SOCAMM2, zaprojektowanego w celu sprostania rosnącym wymaganiom energetycznym i wydajnościowym centrów danych AI. Ten najnowszy moduł stanowi krok naprzód w stosunku do poprzedniej wersji 192GB SOCAMM2 firmy Micron, umożliwiając do 2TB pamięci podłączonej do procesora, zużywając przy tym około jednej trzeciej mocy tradycyjnych zarejestrowanych modułów DDR5 (RDIMM).

Pomimo tej innowacji akcje Micron pozostały w dużej mierze bez zmian we wczesnym handlu w USA, nieznacznie spadając do 400,42 USD, co odzwierciedla ostrożność inwestorów, ponieważ pamięć jest wciąż na etapie próbek i nie została jeszcze wdrożona na pełną skalę.

Micron Technology, Inc., MU

Nvidia popiera projekt o niskim poborze mocy firmy Micron

Ian Finder, szef produktów procesorów centrów danych Nvidia, opisał moduł SOCAMM2 jako "umożliwiający procesorom AI następnej generacji", podkreślając jego potencjalny wpływ na obliczenia o wysokiej wydajności (HPC) i obciążenia generatywnej AI. Współpraca między Micron i Nvidia podkreśla znaczenie dostosowania technologii pamięci do nowoczesnych wymagań procesorów CPU i GPU w celu wsparcia coraz większych modeli AI.

Brendan Burke, analityk w Futurum Research, zauważył, że DRAM o niskim poborze mocy podłączony do procesora staje się kluczową warstwą pamięci dla obciążeń wnioskowania, które mogą generować nagłe skoki zapotrzebowania i zużycia energii. Umieszczając pamięć blisko procesora, SOCAMM2 pomaga zmniejszyć opóźnienia i zużycie energii przy jednoczesnej obsłudze ogromnych zestawów danych wymaganych przez modele AI.

SOCAMM2 zapewnia wydajność i oszczędność miejsca

SOCAMM2, co oznacza moduł pamięci podłączonej kompresji małej obudowy, wykorzystuje pamięć LPDDR5X DRAM typowo spotykaną w smartfonach. Ten projekt nie tylko zmniejsza zużycie energii, ale także redukuje fizyczną powierzchnię pamięci serwerowej, zajmując tylko jedną trzecią miejsca porównywalnych RDIMM.

Wewnętrzne testy Micron z wykorzystaniem dużego modelu językowego Llama 3 70B wykazały ponad 2,3-krotną poprawę w "czasie do pierwszego tokenu", kluczowej metryce wydajności wnioskowania AI.

Monolityczny układ 32-gigabitowy LPDDR5X modułu 256GB umożliwia każdemu ośmiokanałowemu procesorowi serwera obsługę do 2TB pamięci o niskim poborze mocy. To skalowanie oferuje znaczący 33% wzrost pojemności w stosunku do poprzedniej wersji 192GB, czyniąc go atrakcyjnym dla operatorów poszukujących zarówno gęstości, jak i efektywności energetycznej w centrach danych AI.

Perspektywy branżowe i implikacje rynkowe

Podczas gdy Micron przewodzi obok Samsung i SK hynix w rozwoju SOCAMM2 i pamięci o wysokiej przepustowości, szeroka adopcja będzie zależeć od czynników takich jak kwalifikacja klientów, modernizacje systemów i tempo standaryzacji JEDEC. Analitycy ostrzegają, że ograniczenia podaży mogą utrzymywać się do 2027 roku, potencjalnie ograniczając natychmiastowy wpływ wolumenu na przychody Micron.

Zyski firmy za drugi kwartał fiskalny, oczekiwane 18 marca, dostarczą inwestorom sygnałów dotyczących trendów cenowych i wolumenów wysyłek nowych produktów dla centrów danych. Tymczasem Micron kontynuuje współpracę z Nvidia i uczestniczy w grupach standaryzacyjnych, pozycjonując SOCAMM2 do potencjalnej przyszłej ekspansji poza niszowe wysokowydajne aplikacje AI.

Na razie akcje Micron pozostają w dużej mierze stabilne, odzwierciedlając równowagę między obietnicą technologii pamięci następnej generacji a niepewnością związaną z jej komercyjnym wdrożeniem.

Post Micron (MU) Stock; Slight Decline Despite 2TB CPU-Attached Memory Innovatio ukazał się jako pierwszy w CoinCentral.

Możesz także polubić

Prognoza ceny Ethereum na 2026: Pepeto Exchange celuje w 100x przewagę nad ETH i Mutuum Finance, podczas gdy ustawa CLARITY napotyka opór banków

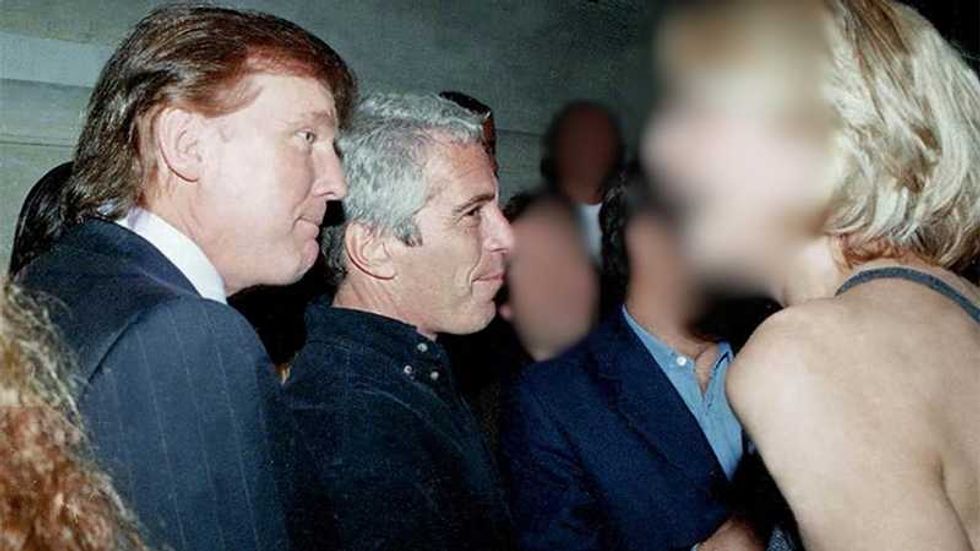

Wymówka dla „pikantnej" obecności Trumpa w aktach Epsteina nie przekonuje: ekspert