Umowa OpenAI z Pentagonem: Sam Altman zabezpiecza kluczowy kontrakt AI z zabezpieczeniami technicznymi

BitcoinWorld

Umowa OpenAI z Pentagonem: Sam Altman zabezpiecza kluczowy kontrakt AI z zabezpieczeniami technicznymi

W przełomowym rozwoju dla zarządzania sztuczną inteligencją, CEO OpenAI Sam Altman ogłosił w piątek 13 października 2025 roku znaczący kontrakt obronny z Departamentem Obrony, ustanawiając zabezpieczenia techniczne, które odnoszą się do krytycznych kwestii etycznych dotyczących wojskowych zastosowań AI. Porozumienie to następuje po spornym impasie między Pentagonem a konkurencyjną firmą AI Anthropic, podkreślając złożone przecięcie bezpieczeństwa narodowego, innowacji technologicznych i wartości demokratycznych w coraz bardziej zautomatyzowanym świecie.

Umowa OpenAI z Pentagonem z zabezpieczeniami technicznymi

Sam Altman ujawnił, że OpenAI osiągnęło porozumienie umożliwiające Departamentowi Obrony dostęp do swoich modeli AI w ramach sieci tajnych. Co ważne, kontrakt zawiera konkretne zabezpieczenia techniczne odnoszące się do dwóch fundamentalnych kwestii etycznych. Po pierwsze, umowa zakazuje aplikacji masowej inwigilacji krajowej. Po drugie, utrzymuje ludzką odpowiedzialność za użycie siły, w tym autonomiczne systemy broni. Te zabezpieczenia reprezentują kompromisową pozycję między nieograniczonym dostępem wojskowym a całkowitą odmową korporacyjną.

Zgodnie z publicznym oświadczeniem Altmana, Departament Obrony zgadza się z tymi zasadami i włączył je zarówno do prawa, jak i polityki. Ponadto OpenAI wdroży zabezpieczenia techniczne, aby zapewnić, że zachowanie modelu jest zgodne z tymi ograniczeniami. Firma wdroży również inżynierów do pracy wraz z personelem Pentagonu, ułatwiając prawidłowe wdrożenie modelu i bieżące monitorowanie bezpieczeństwa. To współpracujące podejście odróżnia strategię OpenAI od bardziej kontrowersyjnych pozycji branżowych.

Impas z Anthropic i podziały etyczne

Umowa OpenAI pojawia się na tle nieudanych negocjacji między Pentagonem a Anthropic. Przez kilka miesięcy urzędnicy obrony naciskali na firmy AI, aby zezwoliły na używanie ich modeli do "wszystkich zgodnych z prawem celów". Jednak Anthropic domagało się wyraźnych ograniczeń dotyczących masowej inwigilacji krajowej i w pełni autonomicznej broni. CEO Dario Amodei argumentował, że w konkretnych przypadkach AI może podważać wartości demokratyczne zamiast ich bronić.

To stanowisko etyczne przyciągnęło znaczące wsparcie ze strony pracowników technologicznych. Ponad 60 pracowników OpenAI i 300 pracowników Google podpisało otwarty list popierający stanowisko Anthropic. List wzywał do przyjęcia podobnych granic etycznych w całej branży, odzwierciedlając rosnące obawy wśród deweloperów AI dotyczące potencjalnych zastosowań wojskowych ich technologii.

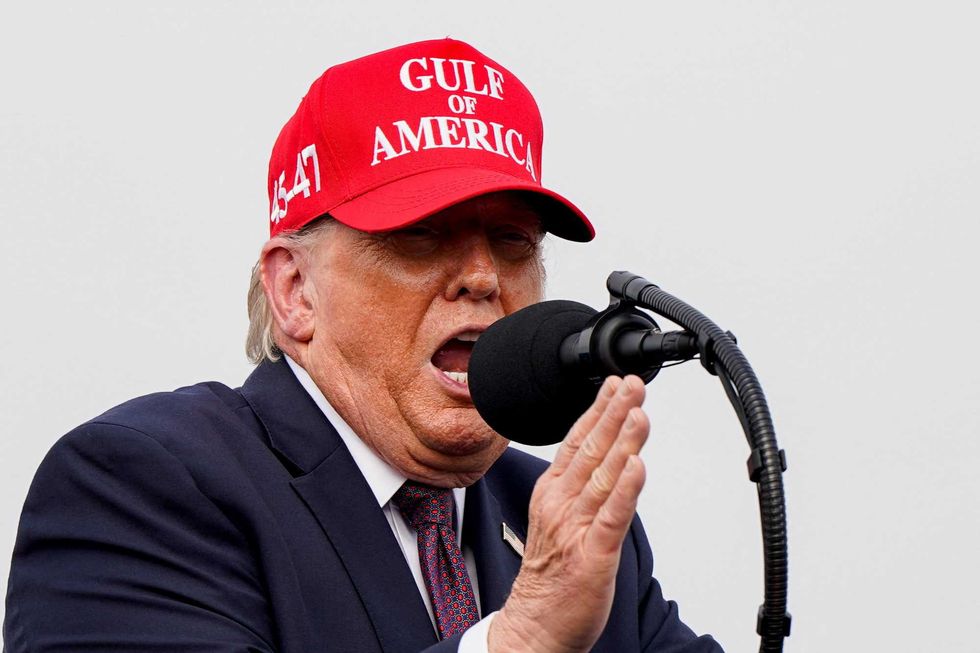

Spór eskalował w publiczną konfrontację z administracją Trumpa. Prezydent Donald Trump skrytykował Anthropic jako "lewicowych świrów" w poście w mediach społecznościowych. Polecił agencjom federalnym wycofać produkty firmy w ciągu sześciu miesięcy. Sekretarz Obrony Pete Hegseth jeszcze bardziej zintensyfikował konflikt, oznaczając Anthropic jako zagrożenie dla łańcucha dostaw. To oznaczenie zakazuje wykonawcom i partnerom prowadzącym interesy z wojskiem angażowania się handlowo z Anthropic.

Implikacje branżowe i krajobraz regulacyjny

Kontrastujące wyniki dla OpenAI i Anthropic ujawniają znaczące implikacje dla branży AI. Firmy muszą teraz poruszać się po złożonych relacjach z podmiotami rządowymi, jednocześnie utrzymując standardy etyczne i zaufanie publiczne. Podejście OpenAI pokazuje, że negocjowane umowy z konkretnymi zabezpieczeniami stanowią realną ścieżkę do przodu. Z drugiej strony doświadczenie Anthropic pokazuje potencjalne konsekwencje przyjęcia bardziej stanowczego stanowiska etycznego wobec żądań rządu.

Ta sytuacja występuje w szerszym kontekście regulacyjnym. Wiele narodów opracowuje ramy dla wojskowych zastosowań AI. Organizacja Narodów Zjednoczonych prowadziła bieżące dyskusje na temat śmiercionośnych autonomicznych systemów broni. Dodatkowo Unia Europejska niedawno wdrożyła swoją ustawę o AI, która zawiera konkretne przepisy dotyczące aplikacji wysokiego ryzyka. Te globalne wydarzenia tworzą coraz bardziej złożone środowisko dla firm AI działających w sektorach obronnych.

Wdrożenie techniczne i protokoły bezpieczeństwa

Umowa OpenAI zawiera kilka komponentów technicznych zaprojektowanych w celu zapewnienia zgodności z zabezpieczeniami etycznymi. Według reporterki Fortune Sharon Goldman, Altman poinformował pracowników, że rząd pozwoli OpenAI zbudować własny "stos bezpieczeństwa", aby zapobiec nadużyciom. Ta infrastruktura techniczna stanowi krytyczny komponent umowy. Ponadto, jeśli model OpenAI odmówi wykonania konkretnego zadania, rząd nie może zmusić firmy do modyfikacji zachowania modelu.

Te środki techniczne odnoszą się do podstawowych obaw dotyczących niezawodności i zgodności systemu AI. Zapewniają mechanizmy zapewniające, że zachowanie AI pozostaje w ustalonych granicach etycznych. Wdrożenie inżynierów OpenAI do pracy bezpośrednio z personelem Pentagonu ułatwia prawidłowe wdrożenie i bieżące monitorowanie. Ten wspólny nadzór techniczny stanowi innowacyjne podejście do partnerstw wojskowo-korporacyjnych w wrażliwych domenach technologicznych.

Porównanie podejść firm AI do kontraktów wojskowych| Firma | Pozycja | Kluczowe zabezpieczenia | Odpowiedź rządu |

|---|---|---|---|

| OpenAI | Wynegocjowana umowa | • Brak masowej inwigilacji krajowej • Ludzka odpowiedzialność za siłę • Zabezpieczenia techniczne • Wdrożenie inżynierów | Kontrakt przyznany z zabezpieczeniami |

| Anthropic | Ograniczenia etyczne | • Brak masowej inwigilacji • Brak autonomicznej broni • Ochrona wartości demokratycznych | Oznaczenie zagrożenia łańcucha dostaw Zarządzono wycofanie produktów |

Szerszy kontekst i wydarzenia międzynarodowe

Umowa OpenAI-Pentagon zbiega się ze znaczącymi wydarzeniami międzynarodowymi. Wkrótce po ogłoszeniu Altmana pojawiły się wiadomości o działaniach wojskowych USA i Izraela przeciwko Iranowi. Prezydent Trump wezwał do obalenia irańskiego rządu. Te jednoczesne wydarzenia podkreślają złożony krajobraz geopolityczny, w którym wdrażane są wojskowe technologie AI. Podkreślają również aktualność rozważań etycznych dotyczących autonomicznych systemów i możliwości inwigilacji.

Globalnie narody realizują zróżnicowane podejścia do integracji wojskowej AI:

- Chiny agresywnie dążyły do wojskowych zastosowań AI z mniejszymi publicznymi ograniczeniami etycznymi

- Rosja wdrożyła autonomiczne systemy w strefach konfliktów z ograniczoną przejrzystością

- Narody europejskie generalnie przyjęły bardziej ostrożne podejścia z silniejszym nadzorem

- Organizacja Narodów Zjednoczonych kontynuuje dyskusje dotyczące potencjalnych traktatów o autonomicznej broni

Ten międzynarodowy kontekst tworzy presje konkurencyjne, które wpływają na krajowe decyzje polityczne. Stany Zjednoczone stoją przed wyzwaniem utrzymania przewagi technologicznej przy jednoczesnym podtrzymywaniu wartości demokratycznych i standardów etycznych. Umowa OpenAI reprezentuje jedno podejście do zrównoważenia tych konkurujących priorytetów.

Perspektywy pracowników i etyka branżowa

Otwarty list podpisany przez setki pracowników AI ujawnia znaczące wewnętrzne napięcia branżowe. Pracownicy technologiczni coraz częściej kwestionują implikacje etyczne swojej pracy, szczególnie dotyczące zastosowań wojskowych. Ten aktywizm pracowniczy stanowi stosunkowo nowe zjawisko w sektorze technologii obronnych. Historycznie wykonawcy obronne napotykali mniejszy wewnętrzny opór wobec zastosowań wojskowych. Jednak firmy AI przyciągają pracowników z silnymi przekonaniami etycznymi dotyczącymi społecznego wpływu technologii.

Ta dynamika tworzy wyzwania zarządcze dla firm AI dążących do kontraktów obronnych. Kierownictwo musi równoważyć relacje rządowe, możliwości biznesowe i obawy pracowników. Podejście OpenAI do negocjowania konkretnych zabezpieczeń stanowi jedną strategię radzenia sobie z tymi konkurującymi naciskami. Gotowość firmy do publicznego popierania przyjęcia podobnych warunków w całej branży sugeruje próbę ustanowienia norm etycznych przy jednoczesnym utrzymaniu dostępu rządowego.

Implikacje prawne i polityczne

Oznaczenie Anthropic jako zagrożenia dla łańcucha dostaw podnosi znaczące pytania prawne. Firma stwierdziła, że zakwestionuje takie oznaczenie w sądzie. Ta potencjalna sprawa sądowa może ustanowić ważne precedensy dotyczące władzy rządowej do ograniczania relacji handlowych na podstawie korporacyjnych pozycji etycznych. Wynik może wpłynąć na to, jak inne firmy AI podchodzą do podobnych negocjacji z podmiotami rządowymi.

Eksperci polityczni zauważają kilka kluczowych rozważań:

- Równowaga między potrzebami bezpieczeństwa narodowego a korporacyjną autonomią etyczną

- Odpowiednia rola zabezpieczeń technicznych w wojskowych systemach AI

- Mechanizmy zapewniające zgodność z ograniczeniami etycznymi

- Międzynarodowe implikacje różnych podejść narodowych

Te pytania polityczne prawdopodobnie otrzymają zwiększoną uwagę w nadchodzących miesiącach. Komitety Kongresu już ogłosiły przesłuchania dotyczące etyki wojskowej AI. Dodatkowo wiele think tanków i instytucji badawczych opracowuje ramy polityczne dla odpowiedzialnego wdrażania wojskowej AI.

Podsumowanie

Umowa OpenAI z Pentagonem z zabezpieczeniami technicznymi stanowi znaczący kamień milowy w integracji wojskowej AI. Umowa pokazuje, że negocjowane podejścia z konkretnymi zabezpieczeniami etycznymi mogą ułatwić dostęp rządowy przy jednoczesnym odnoszeniu się do uzasadnionych obaw. Jednak kontrastujące doświadczenie z Anthropic ujawnia trwające napięcia między priorytetami bezpieczeństwa narodowego a korporacyjnymi standardami etycznymi. W miarę postępu technologii AI te złożone relacje będą wymagały starannego nawigowania. Zabezpieczenia techniczne ustanowione w umowie OpenAI mogą służyć jako model dla przyszłych partnerstw wojskowo-korporacyjnych. Ostatecznie rozwijający się krajobraz wojskowych zastosowań AI będzie wymagał bieżącego dialogu między podmiotami rządowymi, firmami technologicznymi, pracownikami i społeczeństwem obywatelskim, aby zapewnić odpowiedzialną innowację chroniącą zarówno bezpieczeństwo, jak i wartości demokratyczne.

FAQ

P1: Jakie konkretne zabezpieczenia zawiera umowa OpenAI z Pentagonem?

Umowa zakazuje aplikacji masowej inwigilacji krajowej i utrzymuje ludzką odpowiedzialność za użycie siły, w tym autonomiczne systemy broni. OpenAI wdroży zabezpieczenia techniczne i wdroży inżynierów, aby zapewnić zgodność.

P2: Dlaczego negocjacje Anthropic z Pentagonem nie powiodły się?

Anthropic domagało się wyraźnych ograniczeń dotyczących masowej inwigilacji krajowej i w pełni autonomicznej broni, podczas gdy Pentagon naciskał na dostęp do "wszystkich zgodnych z prawem celów". Ten fundamentalny spór uniemożliwił wynegocjowaną umowę.

P3: Jakie konsekwencje poniosło Anthropic za swoje stanowisko etyczne?

Prezydent Trump polecił agencjom federalnym wycofać produkty Anthropic, a Sekretarz Obrony Hegseth oznaczył firmę jako zagrożenie dla łańcucha dostaw, zakazując wykonawcom wojskowym prowadzenia z nimi interesów.

P4: Jak pracownicy branży AI zareagowali na te wydarzenia?

Ponad 360 pracowników z OpenAI i Google podpisało otwarty list wspierający stanowisko etyczne Anthropic, odzwierciedlając znaczące wewnętrzne obawy dotyczące wojskowych zastosowań AI.

P5: Jakie szersze implikacje ma ta sytuacja dla zarządzania AI?

Kontrastujące wyniki podkreślają złożoną równowagę między bezpieczeństwem narodowym, etyką korporacyjną i innowacjami technologicznymi, potencjalnie wpływając na to, jak inne narody i firmy podchodzą do integracji wojskowej AI.

Ten post Umowa OpenAI z Pentagonem: Sam Altman zabezpiecza kluczowy kontrakt AI z zabezpieczeniami technicznymi po raz pierwszy pojawił się na BitcoinWorld.

Możesz także polubić

'Chore': MAGA oszołomiona po tym, jak sondażysta ujawnił posunięcie administracji Trumpa przed operacją wojskową

Bitcoin spadł o 48%, ale najwięksi nabywcy w historii wciąż akumulują