قرارداد OpenAI با پنتاگون: سم آلتمن قرارداد حیاتی هوش مصنوعی را با حفاظتهای فنی تضمین میکند

BitcoinWorld

قرارداد پنتاگون OpenAI: سم آلتمن قرارداد حیاتی AI Agent را با محافظتهای فنی تضمین میکند

در یک توسعه مهم برای حاکمیت هوش مصنوعی، سم آلتمن، مدیرعامل OpenAI، یک قرارداد دفاعی مهم با وزارت دفاع را در جمعه، ۲۲ مهر ۱۴۰۴، اعلام کرد که محافظتهای فنی را برای رسیدگی به نگرانیهای اخلاقی حیاتی پیرامون کاربردهای نظامی AI Agent ایجاد میکند. این توافق پس از یک رویارویی بحثبرانگیز بین پنتاگون و شرکت رقیب AI Agent به نام Anthropic صورت گرفته و تقاطع پیچیده امنیت ملی، نوآوری تکنولوژیکی و ارزشهای دموکراتیک را در دنیایی که به طور فزایندهای خودکار میشود، برجسته میکند.

قرارداد پنتاگون OpenAI با محافظتهای فنی

سم آلتمن فاش کرد که OpenAI به توافقی دست یافته است که به وزارت دفاع اجازه دسترسی به مدلهای AI Agent خود در شبکههای طبقهبندی شده را میدهد. مهم این است که قرارداد شامل حفاظتهای فنی خاصی است که به دو نگرانی اخلاقی اساسی میپردازد. اول، این توافق کاربردهای نظارت انبوه داخلی را ممنوع میکند. دوم، مسئولیت انسانی برای استفاده از نیرو، از جمله سیستمهای سلاح خودکار، را حفظ میکند. این محافظتها موضع مصالحهای بین دسترسی نظامی نامحدود و رد کامل شرکتی را نشان میدهند.

طبق بیانیه عمومی آلتمن، وزارت دفاع با این اصول موافق است و آنها را در قانون و سیاست گنجانده است. علاوه بر این، OpenAI محافظتهای فنی را برای اطمینان از همسویی رفتار مدل با این محدودیتها اجرا خواهد کرد. شرکت همچنین مهندسانی را برای کار در کنار پرسنل پنتاگون مستقر خواهد کرد تا پیادهسازی مناسب مدل و نظارت بر ریسک در زمان واقعی مداوم را تسهیل کند. این رویکرد مشارکتی استراتژی OpenAI را از موضعگیریهای صنعتی متخاصمتر متمایز میکند.

رویارویی Anthropic و تقسیمات اخلاقی

توافق OpenAI در پسزمینه مذاکرات ناموفق بین پنتاگون و Anthropic ظاهر میشود. برای چندین ماه، مقامات دفاعی شرکتهای AI Agent را تحت فشار قرار دادند تا اجازه دهند مدلهای آنها برای "تمام اهداف قانونی" استفاده شوند. با این حال، Anthropic به دنبال محدودیتهای صریح در نظارت انبوه داخلی و سلاحهای کاملاً خودکار بود. مدیرعامل داریو آمودئی استدلال کرد که در موارد خاص، AI Agent میتواند ارزشهای دموکراتیک را تضعیف کند به جای اینکه از آنها دفاع کند.

این موضع اخلاقی حمایت قابل توجهی از کارگران فناوری جذب کرد. بیش از ۶۰ کارمند OpenAI و ۳۰۰ کارمند Google نامه سرگشادهای را امضا کردند که موضع Anthropic را تأیید میکرد. این نامه خواستار پذیرش مرزهای اخلاقی مشابه در سراسر صنعت شد که نگرانی فزاینده توسعهدهندگان AI Agent در مورد کاربردهای نظامی بالقوه فناوریهای آنها را منعکس میکند.

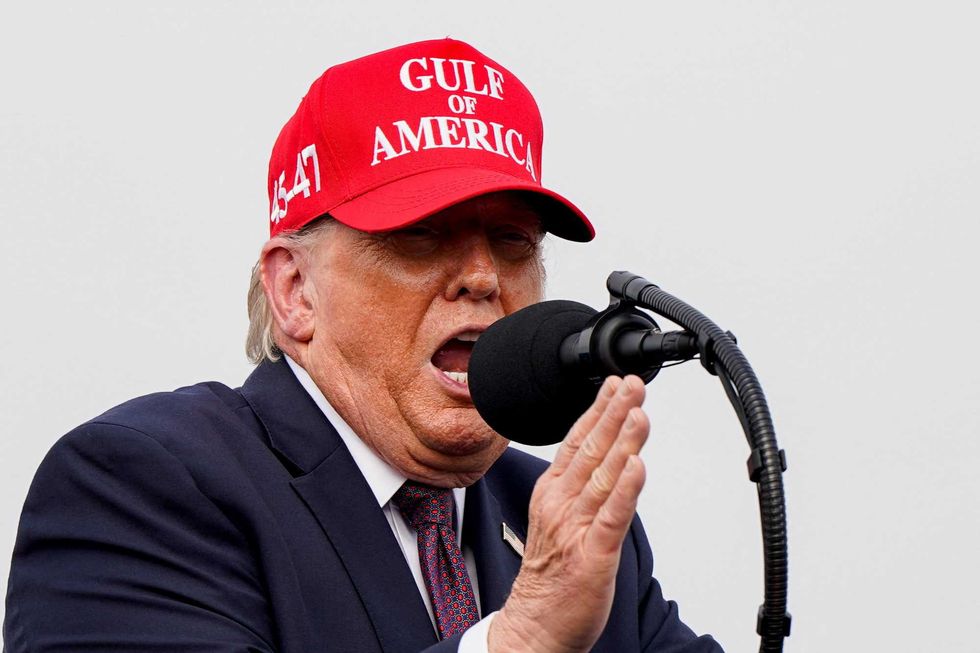

این اختلاف نظر به یک رویارویی عمومی با دولت ترامپ تبدیل شد. رئیسجمهور دونالد ترامپ Anthropic را در یک پست رسانه اجتماعی به عنوان "دیوانگان چپگرا" انتقاد کرد. او آژانسهای فدرال را مأمور کرد تا محصولات شرکت را ظرف شش ماه حذف کنند. وزیر دفاع پیت هگست با تعیین Anthropic به عنوان یک ریسک زنجیره تامین، درگیری را تشدید کرد. این تعیین پیمانکاران و شرکایی که با ارتش تجارت میکنند را از درگیری تجاری با Anthropic منع میکند.

پیامدهای صنعت و چشمانداز نظارتی

نتایج متضاد برای OpenAI و Anthropic پیامدهای مهمی را برای صنعت AI Agent آشکار میکند. شرکتها اکنون باید روابط پیچیده با نهادهای دولتی را هدایت کنند در حالی که استانداردهای اخلاقی و اعتماد عمومی را حفظ میکنند. رویکرد OpenAI نشان میدهد که توافقات مذاکره شده با محافظتهای خاص یک مسیر قابل دوام به جلو را نشان میدهند. برعکس، تجربه Anthropic پیامدهای بالقوه اتخاذ موضع اخلاقی محکمتر در برابر خواستههای دولت را نشان میدهد.

این وضعیت در یک زمینه نظارتی گستردهتر رخ میدهد. کشورهای متعدد در حال توسعه چارچوبهایی برای کاربردهای نظامی AI Agent هستند. سازمان ملل متحد بحثهای مداوم درباره سیستمهای سلاح خودکار کشنده انجام داده است. علاوه بر این، اتحادیه اروپا اخیراً قانون AI Agent خود را اجرا کرده است که شامل مقررات خاص برای کاربردهای پرخطر است. این تحولات جهانی یک محیط پیچیدهتر برای شرکتهای AI Agent که در بخشهای دفاعی فعالیت میکنند ایجاد میکند.

پیادهسازی فنی و پروتکلهای ایمنی

توافق OpenAI شامل چندین مؤلفه فنی است که برای اطمینان از انطباق با محافظتهای اخلاقی طراحی شده است. به گفته شارون گلدمن، خبرنگار Fortune، آلتمن به کارکنان اطلاع داد که دولت به OpenAI اجازه خواهد داد تا "استخر استراتژی ایمنی" خود را برای جلوگیری از سوء استفاده بسازد. این زیرساخت فنی یک مؤلفه حیاتی از توافق را نشان میدهد. علاوه بر این، اگر یک مدل OpenAI از انجام یک کار خاص امتناع کند، دولت نمیتواند شرکت را مجبور به تغییر رفتار مدل کند.

این اقدامات فنی به نگرانیهای اصلی در مورد قابلیت اطمینان و همسویی سیستم AI Agent میپردازند. آنها مکانیسمهایی را برای اطمینان از اینکه رفتار AI Agent در مرزهای اخلاقی تعیین شده باقی میماند فراهم میکنند. استقرار مهندسان OpenAI برای کار مستقیم با پرسنل پنتاگون، پیادهسازی مناسب و نظارت بر ریسک در زمان واقعی مداوم را تسهیل میکند. این نظارت فنی مشارکتی یک رویکرد نوآورانه به مشارکتهای نظامی-شرکتی در حوزههای فناوری حساس را نشان میدهد.

مقایسه رویکردهای شرکتهای AI Agent به قراردادهای نظامی| شرکت | موضع | محافظتهای کلیدی | پاسخ دولت |

|---|---|---|---|

| OpenAI | توافق مذاکره شده | • بدون نظارت انبوه داخلی • مسئولیت انسانی برای نیرو • محافظتهای فنی • استقرار مهندسان | قرارداد با محافظتها اعطا شد |

| Anthropic | محدودیتهای اخلاقی | • بدون نظارت انبوه • بدون سلاحهای خودکار • حفاظت از ارزشهای دموکراتیک | تعیین ریسک زنجیره تامین دستور حذف محصول |

زمینه گستردهتر و تحولات بینالمللی

توافق OpenAI-پنتاگون همزمان با تحولات بینالمللی مهم است. کمی پس از اعلام آلتمن، اخباری در مورد اقدامات نظامی ایالات متحده و اسرائیل علیه ایران ظاهر شد. رئیسجمهور ترامپ خواستار سرنگونی دولت ایران شد. این تحولات همزمان چشمانداز ژئوپلیتیک پیچیدهای را برجسته میکنند که در آن فناوریهای نظامی AI Agent مستقر میشوند. آنها همچنین بر به موقع بودن ملاحظات اخلاقی پیرامون سیستمهای خودکار و قابلیتهای نظارتی تأکید میکنند.

در سطح جهانی، کشورها رویکردهای متنوعی را برای یکپارچهسازی نظامی AI Agent دنبال میکنند:

- چین به طور تهاجمی کاربردهای نظامی AI Agent را با محدودیتهای اخلاقی عمومی کمتری دنبال کرده است

- روسیه سیستمهای خودکار را در مناطق درگیری با شفافیت محدود مستقر کرده است

- کشورهای اروپایی به طور کلی رویکردهای محتاطانهتر با نظارت قویتر را اتخاذ کردهاند

- سازمان ملل متحد بحثها در مورد معاهدات احتمالی درباره سلاحهای خودکار ادامه دارد

این زمینه بینالمللی فشارهای رقابتی ایجاد میکند که بر تصمیمات سیاست داخلی تأثیر میگذارد. ایالات متحده با چالش حفظ برتری تکنولوژیکی در حالی که ارزشهای دموکراتیک و استانداردهای اخلاقی را حفظ میکند، روبرو است. توافق OpenAI یک رویکرد برای متعادل کردن این اولویتهای رقابتی را نشان میدهد.

دیدگاههای کارکنان و اخلاق صنعت

نامه سرگشاده امضا شده توسط صدها کارمند AI Agent تنشهای داخلی قابل توجه صنعت را آشکار میکند. کارگران فناوری به طور فزایندهای پیامدهای اخلاقی کار خود را، به ویژه در مورد کاربردهای نظامی، زیر سؤال میبرند. این فعالیت کارکنان یک پدیده نسبتاً جدید در بخش فناوری دفاعی را نشان میدهد. از نظر تاریخی، پیمانکاران دفاعی با مقاومت داخلی کمتری نسبت به کاربردهای نظامی مواجه شدند. با این حال، شرکتهای AI Agent کارکنانی با اعتقادات اخلاقی قوی در مورد تأثیر اجتماعی فناوری جذب میکنند.

این پویایی چالشهای مدیریتی را برای شرکتهای AI Agent که قراردادهای دفاعی را دنبال میکنند ایجاد میکند. رهبری باید روابط دولتی، فرصتهای تجاری و نگرانیهای کارکنان را متعادل کند. رویکرد OpenAI در مذاکره محافظتهای خاص یک استراتژی برای رسیدگی به این فشارهای رقابتی را نشان میدهد. تمایل شرکت به حمایت عمومی از پذیرش شرایط مشابه در سراسر صنعت نشاندهنده تلاشی برای ایجاد هنجارهای اخلاقی در حالی که دسترسی دولتی را حفظ میکند.

پیامدهای قانونی و سیاست

تعیین ریسک زنجیره تامین Anthropic سؤالات قانونی مهمی را مطرح میکند. شرکت اعلام کرده است که هر گونه تعیین را در دادگاه به چالش خواهد کشید. این دعوای بالقوه میتواند سوابق مهمی را در مورد اختیار دولت برای محدود کردن روابط تجاری بر اساس موضعگیریهای اخلاقی شرکتی ایجاد کند. نتیجه ممکن است بر نحوه برخورد سایر شرکتهای AI Agent با مذاکرات مشابه با نهادهای دولتی تأثیر بگذارد.

کارشناسان سیاست به چندین ملاحظه کلیدی اشاره میکنند:

- تعادل بین نیازهای امنیت ملی و استقلال اخلاقی شرکتی

- نقش مناسب محافظتهای فنی در سیستمهای نظامی AI Agent

- مکانیسمها برای اطمینان از انطباق با محدودیتهای اخلاقی

- پیامدهای بینالمللی رویکردهای ملی متفاوت

این سؤالات سیاست احتمالاً در ماههای آینده توجه بیشتری دریافت خواهند کرد. کمیتههای کنگره قبلاً جلسات استماع در مورد اخلاق نظامی AI Agent را اعلام کردهاند. علاوه بر این، چندین اندیشکده و مؤسسه تحقیقاتی در حال توسعه چارچوبهای سیاست برای استقرار مسئولانه نظامی AI Agent هستند.

نتیجهگیری

قرارداد پنتاگون OpenAI با محافظتهای فنی یک نقطه عطف مهم در یکپارچهسازی نظامی AI Agent را نشان میدهد. این توافق نشان میدهد که رویکردهای مذاکره شده با حفاظتهای اخلاقی خاص میتوانند دسترسی دولت را تسهیل کنند در حالی که به نگرانیهای مشروع میپردازند. با این حال، تجربه متضاد با Anthropic تنشهای مداوم بین اولویتهای امنیت ملی و استانداردهای اخلاقی شرکتی را آشکار میکند. همانطور که فناوریهای AI Agent به پیشرفت ادامه میدهند، این روابط پیچیده نیاز به هدایت دقیق خواهند داشت. محافظتهای فنی ایجاد شده در توافق OpenAI ممکن است به عنوان الگویی برای مشارکتهای نظامی-شرکتی آینده عمل کند. در نهایت، چشمانداز در حال تکامل کاربردهای نظامی AI Agent به گفتگوی مداوم بین نهادهای دولتی، شرکتهای فناوری، کارکنان و جامعه مدنی نیاز خواهد داشت تا اطمینان حاصل شود که نوآوری مسئولانه هم امنیت و هم ارزشهای دموکراتیک را محافظت میکند.

سؤالات متداول

سؤال ۱: محافظتهای خاص قرارداد پنتاگون OpenAI چیست؟

این توافق کاربردهای نظارت انبوه داخلی را ممنوع میکند و مسئولیت انسانی برای استفاده از نیرو، از جمله سیستمهای سلاح خودکار را حفظ میکند. OpenAI محافظتهای فنی را اجرا خواهد کرد و مهندسان را برای اطمینان از انطباق مستقر خواهد کرد.

سؤال ۲: چرا مذاکرات Anthropic با پنتاگون شکست خورد؟

Anthropic به دنبال محدودیتهای صریح در نظارت انبوه داخلی و سلاحهای کاملاً خودکار بود، در حالی که پنتاگون به دنبال دسترسی برای "تمام اهداف قانونی" بود. این اختلاف نظر اساسی مانع از یک توافق مذاکره شده شد.

سؤال ۳: Anthropic چه پیامدهایی را برای موضع اخلاقی خود متحمل شده است؟

رئیسجمهور ترامپ آژانسهای فدرال را مأمور کرد تا محصولات Anthropic را حذف کنند، و وزیر دفاع هگست شرکت را به عنوان یک ریسک زنجیره تامین تعیین کرد که پیمانکاران نظامی را از تجارت با آنها منع میکند.

سؤال ۴: کارکنان صنعت AI Agent چگونه به این تحولات پاسخ دادهاند؟

بیش از ۳۶۰ کارمند از OpenAI و Google نامه سرگشادهای را امضا کردند که از موضع اخلاقی Anthropic حمایت میکرد و نگرانی داخلی قابل توجهی در مورد کاربردهای نظامی AI Agent را منعکس میکند.

سؤال ۵: این وضعیت چه پیامدهای گستردهتری برای حاکمیت AI Agent دارد؟

نتایج متضاد تعادل پیچیده بین امنیت ملی، اخلاق شرکتی و نوآوری تکنولوژیکی را برجسته میکنند و به طور بالقوه بر نحوه برخورد سایر کشورها و شرکتها با یکپارچهسازی نظامی AI Agent تأثیر میگذارند.

این پست قرارداد پنتاگون OpenAI: سم آلتمن قرارداد حیاتی AI Agent را با محافظتهای فنی تضمین میکند اولین بار در BitcoinWorld ظاهر شد.

محتوای پیشنهادی

'بیمار': هواداران MAGA پس از افشای اقدام دولت ترامپ پیش از عملیات نظامی توسط نظرسنج شگفتزده شدند

بیت کوین 48% کاهش یافته، اما بزرگترین خریداران تاریخ همچنان در حال جمعآوری هستند